自然语言处理方向设立两大技术论坛@CNCC | 数图回看

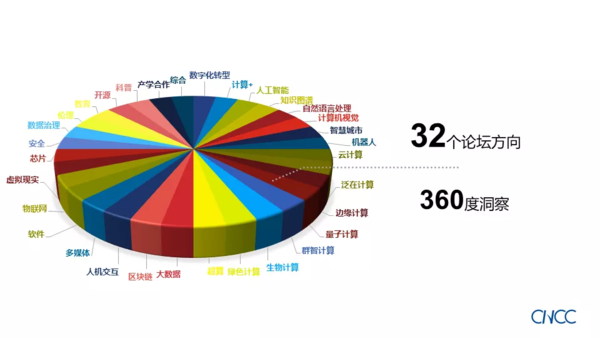

导读:一年一度的CNCC(中国计算机大会)即将于2021年10月28-30日召开,在计算领域专业人士的支持下,本届大会共开设了111个技术论坛,涉及学术、技术、产业、教育、科普等方面共计32个方向,令人耳目一新。其中自然语言处理方向技术论坛有两个,分别是:复杂交互场景下的自然语言理解、自然语言生成技术前沿与产业发展。

自然语言处理 | ||

论坛主题 | 论坛主席 | 所在单位 |

复杂交互场景下的自然语言理解 | 周国栋 | 苏州大学 |

自然语言生成技术前沿与产业发展 | 万小军 | 北京大学 |

讲者:宋睿华 博士,中国人民大学高瓴人工智能学院长聘副教授

简介:尽管深度神经语言模型让生成一段通顺的自然语言越来越容易,人类的创作能力却不止于此。在这个演讲中,我想从创作的独特性出发,探讨一下人工智能是否可以像人类的创作者一样写出新颖的比喻或是编排出有戏剧冲突的台词。

讲者:万小军 北京大学王选计算机研究所博士生导师,语言计算与互联网挖掘研究室负责人。

简介:能够生成多样化的文本是很多文本生成应用的重要需求之一。尽管基于深度学习的自然语言生成取得了令人兴奋的进步,但目前的自然语言生成系统仍面临生成文本的多样性不足等问题。本次演讲将与大家探讨多样化文本生成技术。

讲者:黄民烈 博士,清华大学计算机科学与技术系长聘副教授

简介:现有的语言生成模型对知识的表示和利用存在显著不足。即使最强大的GPT-2/3,依然存在很显著的知识冲突问题,尤其是常识问题。讲者将介绍如何将知识融入语言生成模型的研究尝试,并介绍在需要常识推理的语言生成任务(如常识解释、归因推理、故事结局生成等)中的应用。

讲者:史树明 博士,腾讯AI Lab自然语言处理中心负责人、专家研究员

简介:在最近几年的学术论文中,“深度神经语言模型”几乎就是“文本生成技术”的代名词,俨然已经成为应对文本生成任务的万金油;相比而言,传统语言模型、文本模板等技术则多了一丝沧桑和老态龙钟的感觉。那么在真实的工业场景中,这些不同的文本生成技术的使用情况、定位与角色是怎样的呢?讲者将分享把文本生成技术用于智能对话、电竞解说、诗词对联歌词创作等场景中的实践情况,并分析对比不同技术在不同场景的下的适用性和优劣。

讲者:肖欣廷 百度主任架构师,篇章理解与语言生成技术负责人

简介:受益于深度学习特别是预训练技术的突破,自然语言生成模型输出的文本质量不断提升,这是否意味着人工智能赋能内容创作的大规模应用马上到来?为探讨此问题,本报告将介绍百度在自然语言生成方向的技术进展,以及相关技术在多模内容创作中的应用,并基于百度的实践经验探讨自然语言生成的前景和挑战。

讲者:李磊 博士,原字节跳动 AI 实验室总监

简介:本次报告将介绍 Xiaomingbot,一款多语言多模态的新闻机器人。她能实现从结构化数据到 多语言新闻文本的生成,并生成摘要。利用跨语言声音克隆技术,她也具备将多语言文本用同一种播 报者的语音语调播出。利用脸部表情动作同步技术,她能合成生动的虚拟主播,脸部动作保持与语音 播报文字的同步。自问世以来,已经在社交媒体生产文稿 60 万余篇。我们也将展望自动文本写作技术 的挑战和未来发展前景。

今年CNCC大会主题是“计算赋能加速数字化转型”。今年的特邀嘉宾包括ACM图灵奖获得者John Hopcroft教授和Barbara Liskov教授,南加州大学计算机科学系和空间研究所Yolanda Gil教授,陈维江、冯登国、郭光灿、孙凝晖、王怀民等多位院士,及众多深具业内影响力的专家。

CNCC2021将汇聚国内外顶级专业力量、专家资源,为逾万名参会者呈上一场精彩宏大的专业盛宴。别缺席,等你来!(阅读原文了解更多)

返回首页

返回首页