专家谈术语 | 神经网络后门

本期发布术语热词:神经网络后门(Neural Network Backdoor/Trojan)

神经网络后门

(Neural Network Backdoor/Trojan)

作者:陈恺、赵月(中国科学院信息工程研究所)

InfoBox:

中文名:神经网络后门

英文名:Neural Network Backdoor/Trojan

基本定义

神经网络后门是近年来人工智能安全领域的重要研究方向之一。其基本含义是,攻击者通过污染训练数据、修改模型权重、修改模型架构等方法,调整神经网络模型,使其对带有特定触发器(Trigger)的输入产生指定的输出。神经网络后门应不易被用户察觉和移除,不应影响神经网络的正常功能。

实质

神经网络后门是向神经网络模型中注入的隐藏行为,该行为会被含有特定“触发器”的输入触发,产生攻击者所期望的结果。其基本目标有两个,一是对于没有触发器的正常输入,后门模型的行为与正常模型一致。二是当输入含有攻击者指定的触发器时,后门模型就会表现出异常的行为。神经网络后门的相关研究对于自动驾驶、人脸识别门禁等应用场景具有重要的意义。

背景与动机

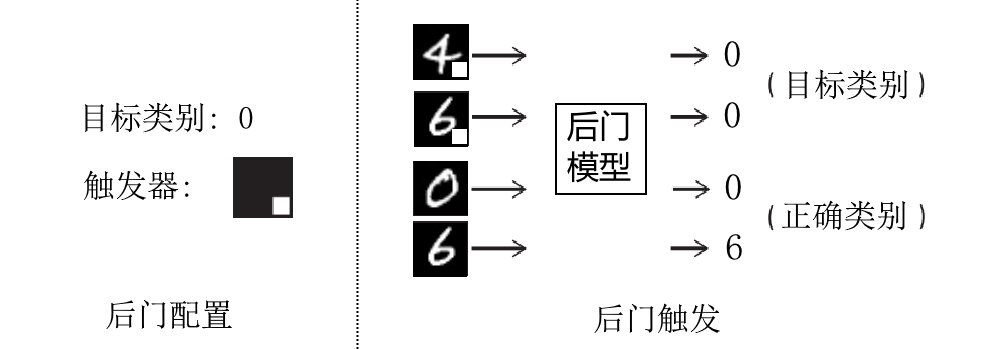

神经网络后门需要对模型进行修改植入后门,这一点与对抗样本不同。攻击者通过让模型学到攻击者预设的知识,让神经网络产生预设的行为。如图1所示,攻击者在一个手写数字识别模型上植入后门:触发器是一个位于图像右下角的小方块,攻击者可以通过触发器来控制后门模型的行为,即带有触发器的数字图像都被识别为数字0,而不带有触发器的数字图像会被正确识别。除去后门攻击外,神经网络后门也有善意应用,例如模型的拥有者通过向神经网络模型中插入一个自定义的、不被发现的后门,可以借此证明自己对该模型的所有权。

图1 神经网络后门示例

研究概况

•后门攻击

后门攻击的研究旨在寻找有效的后门植入方法。包括:研究如何通过不同的途径进行攻击,例如训练数据投毒[1]、篡改预训练模型[2]、代码投毒[3]等;研究不同类型的触发器和适用不同场景的后门攻击算法,例如动态触发器后门攻击[4]、语义后门攻击[5]、无数据后门攻击[6]等。

•后门防御

后门防御的研究旨在寻找防御后门攻击的方法。包括:在模型训练阶段,检测并清除训练数据集中的污染数据[7];在模型部署阶段,检测模型是否存在后门并清除模型中的后门,例如通过逆向触发器以发现后门[8],或者通过微调模型等方式清除后门[9]等;在模型运行阶段,检测输入数据是否存在后门触发器以及对输入进行预处理[10],从而发现或防御后门。

未来展望

神经网络后门是目前的研究热点。一方面是寻找在神经网络开发和部署的各个环节中植入后门的可能性,以及多样化的后门攻击;另一方面是寻找有效的后门检测与防御方法,尤其是具有理论保障的后门防御方法。对神经网络后门的研究,既是关于人工智能安全的研究,也能够加强对人工智能技术本身的认识。

参考文献

计算机术语审定委员会及术语平台介绍:

计算机术语审定委员会(Committee on Terminology)主要职能为收集、翻译、释义、审定和推荐计算机新词,并在CCF平台上宣传推广。这对厘清学科体系,开展科学研究,并将科学和知识在全社会广泛传播,都具有十分重要的意义。 术语众包平台CCFpedia的建设和持续优化,可以有效推进中国计算机术语的收集、审定、规范和传播工作,同时又能起到各领域规范化标准定制的推广作用。 新版的CCFpedia计算机术语平台(http://term.ccf.org.cn)将术语的编辑运营与浏览使用进行了整合,摒弃老版中跨平台操作的繁琐步骤,在界面可观性上进行了升级,让用户能够简单方便地查阅术语信息。同时,新版平台中引入知识图谱的方式对所有术语数据进行组织,通过图谱多层关联的形式升级了术语浏览的应用形态。

计算机术语审定工作委员会:

主任:

刘 挺(哈尔滨工业大学)

副主任:

王昊奋(同济大学)

李国良(清华大学)

主任助理:

李一斌(上海海乂知信息科技有限公司)

执行委员:

丁军(上海海乂知信息科技有限公司)

林俊宇(中国科学院信息工程研究所)

兰艳艳(清华大学)

张伟男(哈尔滨工业大学)

委员:

柴成亮(北京理工大学)

彭鑫(复旦大学)

李博涵(南京航空航天大学)

李超(上海交通大学)

李晨亮(武汉大学)

杨敏(中国科学院深圳先进技术研究院)

张鹏(天津大学)

王昌栋(中山大学)

张宁豫(浙江大学)

孔祥杰(浙江工业大学)

术语投稿热线:ccfpedia@ccf.org.cn

返回首页

返回首页