为什么ChatGPT没有诞生在中国?三只「拦路虎」|CCF C³

ChatGPT爆火之后,算力问题也被推到了风口浪尖。

根据OpenAI CEO的说法,每调用一次ChatGPT就会消耗几美分。那么如果全球每人都搜索一下,为什么OpenAI不会破产?

全国的A100显卡就那么几万卡,如果大家都去炼大模型,算力不够用怎么办?

……

CCF CTO Club发起的最新一期CCF C³活动就来到并行科技,话题聚焦于“算力网络赋能人工智能”,以ChatGPT这一热门话题为引子,展开了一场多维度的主题分享和讨论。

据统计,线上约有9500人围观了此次活动。

所以,具体都讲了些什么?

训练千亿大模型,至少面临三大挑战

活动最先开始的主题分享环节,北京大学人工智能研究院助理教授(博导)杨耀东讲了一个非常有趣的东西,即微软最新公布的一个研究项目。

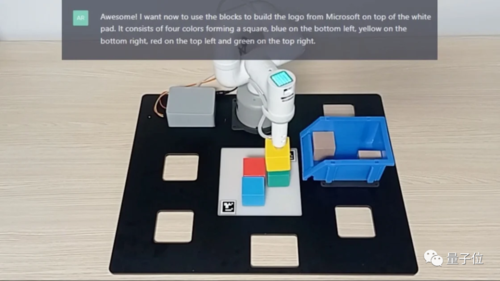

该项目直接将ChatGPT的输出接到一个机械臂以及一个微机上。然后通过人与ChatGPT交互,来控制机械臂完成特定任务,比如用一堆方块拼成一个微软的logo。

杨耀东告诉大家,这项研究非常有意义。

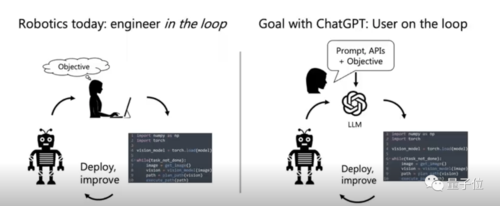

如下图所示,以往我们要完成类似任务,需要人去编程。

现在有了ChatGPT之后,我们要做的就不再是设计程序,而是设计一个prompt或者是一个instruct,让ChatGPT通过这个prompt或instruct去编程,进而完成对机械臂的控制。

ChatGPT还有这种妙处?着实让人感到惊喜。

那么问题来了:

这么一个好东西,为什么没有先在中国诞生?是我们完全没有关注这件事情吗?

北京智谱华章科技有限公司的CEO张鹏,在ChatGPT爆火后经常被问到这个问题。

对此,他想说,并非没有关注,国内如华为、达摩院、清华大学等机构一直在做类似的事情。

比如清华大学知识工程实验室(KEG)与智谱AI共同研发的大规模中英文预训练语言模型GLM-130B。

它可与GPT-3基座模型对标,在同等运算速度与精度的要求下,GLM-130B对显存资源的消耗可节省75%,自2022年8月发布以来,已收到41个国家266个研究机构的使用需求。

在Stanford报告的世界主流大模型评测中,它更是中国唯一入选的模型,其准确性、恶意性与GPT-3持平,鲁棒性和校准误差在所有模型中表现最佳。

但,不得不承认,ChatGPT的实力确实非常强大。

而我们要想训练类似一个千亿大模型,至少要面临三大挑战:

一、高昂的训练成本。比如ChatGPT的算力需求就是“A100x1000块x30天”。

二、人力投入极大。比如谷歌PaLM 530B团队,前期准备29人,训练过程11人,整个作者列表68人,而目前国内可用做大模型的高精尖人才不超过百人。

三、训练过程不稳定,且调试困难,容易出现训练不收敛现象。

张鹏指出,在这些问题之中,算力绝对是非常重要的因素。

他曾经估算过,从GPT3开始到ChatGPT的诞生,中间用来训练模型用的算力,达到了亿美金以上的规模。

更别说这还只是对“成功部分”的估计,如果算上训练失败和试错的成本,这个数字肯定又要翻几番。

因此,我们要想搞千亿大模型,算力问题一定不可忽视。

算力网络实现算力全国共享

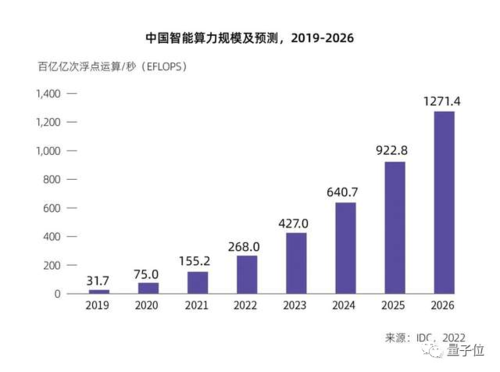

根据IDC发布的报告,中国AI算力规模增长飞速,2022年为268EFLOPS,到2026年则可达1271.4EFLOPS。

但在并行科技董事长陈健看来,ChatGPT爆火之后,这个增长速度根本不够:大家要么仍然缺算力,要么缺合适的算力。

因此,他提出了“可用、好用以及降本”这三个概念。

他介绍道,并行科技从超算起家,一直专注于算力行业,目前公司在做的全国一体化算力网络,就是要将国内优质的超算、智算与通用算力全部聚合起来,形成一个算力资源、应用资源、数据资源可以共享和交易的算力网络。

这个网络可以确保当我们需要用算力的时候,只要中国还有可用的空闲算力,我们就能用到。

当然,它的价格一定要合理。

据悉,并行科技目前与广州超算、北京超算、济南超算、中科院超算、浙江超算、宁夏超算等国产算力资源在内的大批优质算力资源结合,共计接入超80000台服务器,总计算力超1000PFlops,存储资源超800PB。

算法优化也是一条途径

在主题讨论环节,大家一齐分享了自己对如何解决算力需求这个问题的看法。

在智谱AI CEO张鹏看来,算力是由市场驱动的,只要符合市场需求,创造出真正的社会价值,就有办法解决。

而且,这个办法一定是多元化的。

比如在硬件层面,我们可以打造更先进的芯片;在宏观资源调度方面,如并行科技陈健所说,算力网络是一个好思路。

而最终,可能将形成宏观层有算力网络,硬件层有强大芯片,中间层有软件做算法优化与加速这种“多向奔赴”的方式。

此外,他也认为,特异化也可能会成为解决AI算力的一种趋势。因为就拿芯片来说,通用芯片的成本一定会比专用的高。

对此,中科院计算机网络信息中心AI技术与应用发展部负责人王彦棡补充道,在人工智能领域,软件的确是需要大家关注的重点,它是构成行业生态的关键,容易出现“卡脖子”问题,做好未雨绸缪,才能应对不断变化的发展时局。

陈健则在这个环节分享了当天刷到的一条朋友圈:

已经摸到一定高度的情况下,再去比参数谁多是不明智的。要比谁用更少的参数,更少的算力,也能达到同样的效果,包括性能和体验。

这条朋友圈来自某位行业专家。

陈健对此颇为赞同,他表示:我们做优化的都知道,最好的优化不是在硬件上去调整性能,而是用一个更好的算法,让总计算量降下去,从而提高更好的体验。

因此,陈健认为,这也是解决算力问题一个非常非常好的路径,如果这一点上能突破,可能对算力公司来说不是好消息,但是对于我们整个社会来说是非常巨大的进步。

接下来,大家还就本期的主题算力网络进行了更深一步的讨论。

并行科技AI云事业部总经理赵鸿冰表示,算力网络接下来的发展重点是算力接入标准化。有了标准,更多算力资源才能被有效的接入到算力网络中,满足需求端的灵活使用。

历史上,电力网络的构建曾为人类带来福祉。现在我们也可以畅想一下,未来是否可以基于算力网络来实现大模型训练。

当然,这需要我们在算力网络分布式计算技术等相关领域做进一步研究。

现场提问

本场活动的最后环节,是留给线上线下观众的现场提问,不少人将目光聚集到了ChatGPT本身。

有人关心ChatGPT是否需要做算法方面的创新。

对此,杨耀东表示,对它来说,可能不需要。

他引用了ChatGPT项目负责人的一句话:

人们通常会低估一个简单的想法实现好后对效能的增长;而过于高估一个全新想法能带来的效能增长。

因此他认为,即便ChatGPT看似简单,如果能在工程化方面做到极致,也会有非常好的应用效果。

前些日子,有研究发现ChatGPT背后的大模型具有9岁儿童心智。

现在,也有人将类似问题抛给了现场嘉宾:

基于ChatGPT目前在应用中的表现,是否可以判定它已经产生了智能?

对于这个问题,杨耀东也发表了看法。他认为从某种角度上来看,我们可以说ChatGPT已经产生了“智能”。就比如面对鸡兔同笼问题,换个数它依然能解,不会出现突然到某个层级不能泛化的问题。

但是它底层的模型,说到底就是一些Encode和Decoder,基于Attentio架构的东西。它为什么能涌现出这么复杂的pattern?

这还是数据带来的归纳偏置非常多以后,涌现出来一定意义上的智能所带来的。

但是这个智能是不是我们科学意义上定义的智能,或者我们怎么去定义智能——这个问题本身还很难说清楚。

关于CCF C³

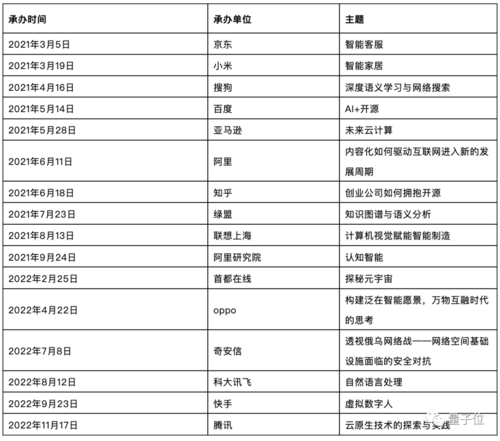

CCF C³活动是由中国计算机学会CCF CTO Club发起的,旨在联结企业CTO及高级技术人才和资深学者,每次以一个技术话题为核心,走进一家技术领先企业。

往期活动承办单位与主题如下表所示:

下一期,C³将移步上海,由小红书承办,时间为3月30日。

— 完 —

(本文转载自量子位)

返回首页

返回首页