CNCC | 网络生态治理论坛:大模型安全——路在何方?

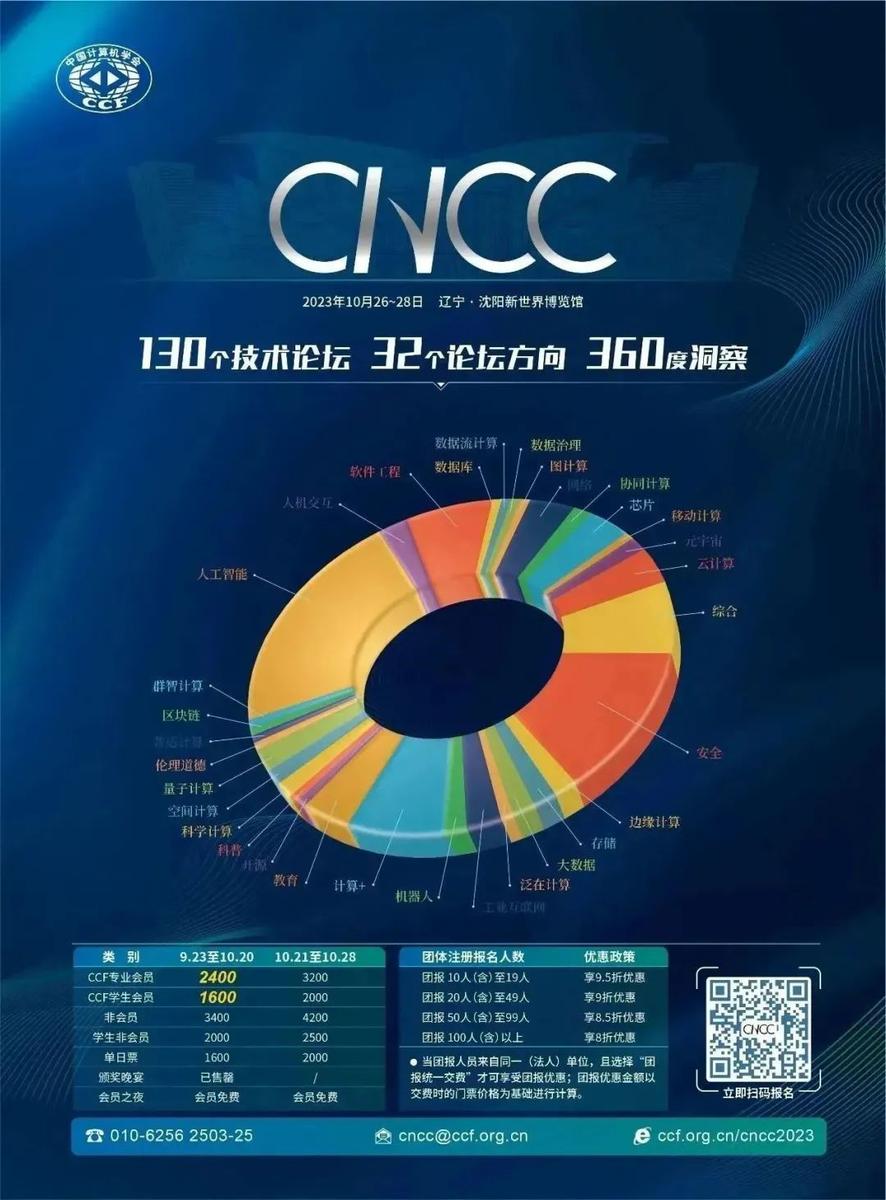

CNCC2023将于10月26日至28日在沈阳举行,会议期间将举办130场技术论坛,涵盖人工智能、安全、计算+、软件工程、教育、网络、芯片、云计算等30余个方向。本文特别介绍将于10月27日举办的【第三届网络生态治理论坛:大模型安全——路在何方?】技术论坛。

本论坛聚焦大模型最新进展及其所面临的安全与伦理难题,邀请相关领域的学者、科研人员、企业一线专家,就大模型的科学问题、新范式下的研究方向、大模型的安全性挑战、最新技术进展与安全实践等问题展开深入的讨论。

万人盛会即将开幕,报名仍在持续进行中,800余位技术论坛专家邀你相约沈阳,共享学术盛宴!立即扫码报名参会。

GPT-3.5/4等现象级大模型的推出,引发了社会各界的广泛关注与热议。大模型涌现出的惊人能力,正在为我们揭开新一代人工智能发展的面纱,并有望引发深刻的社会变革,重塑人类的生产与生活。与此同时,日益强大的模型也打开了新的潘多拉魔盒,造假、偏见、歧视、公平性等问题以及隐私泄露、对抗样本恶意攻击等潜在风险,正在不断增加人类社会对风险的隐忧。图灵奖得主Hinton、Bengio以及 OpenAI CEO Altman等产学两届专家联名签署的“人工智能风险声明”,更将其带来的灭绝性风险(risk of extinction)上升到了堪比核战争的高度。如何对“亦正亦邪”的大模型行为进行规制,把智能能力“关到制度笼子里”成为我们亟需面对的重大科学挑战。

今年的网络生态治理论坛聚焦大模型与安全,非常荣幸地邀请到了来自清华、复旦等大模型研发团队以及阿里、讯飞等产业界一线专家和学者,就大模型及其安全话题分享精彩的报告,并将在Panel环节开展产学两届的深度对话。期待您的参与,一起探索大模型安全的解决之道。

论坛安排

顺序 | 主题 | 主讲嘉宾 | 单位 |

1 | 大模型「十问」,寻找新范式下的研究方向 | 刘知远 | 清华大学 |

2 | 讯飞星火模型最新技术进展及安全实践 | 王士进 | 科大讯飞 |

3 | 大语言模型的安全性研究 | 黄民烈 | 清华大学 |

4 | 大模型时代的算法治理与实践 | 薛晖 | 阿里巴巴集团 |

5 | 大型语言模型的科学挑战 | 邱锡鹏 | 复旦大学 |

Panel嘉宾 | 刘知远 | 清华大学 | |

王士进 | 科大讯飞 | ||

黄民烈 | 清华大学 | ||

薛晖 | 阿里巴巴集团 | ||

邱锡鹏 | 复旦大学 | ||

虎嵩林 | 中国科学院信息工程研究所 |

论坛主席

虎嵩林

中国科学院信息工程研究所研究员

CCF杰出讲者,中国科学院大学岗位教授,博导。主要研究方向内容安全、大数据智能处理、知识图谱等,在包括SIGMOD、VLDB、ACL、AAAI、IJCAI、ICDE、ICDCS等会议和国内外期刊上发表学术论文百余篇;应用上聚焦知识增强的内容安全,作为应用总师、技术总师等承建多个国家级重大工程。获得国家专利奖一项,获得北京市科技进步二等奖等多项省部级科技奖励。

共同主席

刘知远

清华大学计算机系副教授/博导

主要研究方向为表示学习、知识图谱和社会计算,已在ACL、EMNLP、IJCAI、AAAI等人工智能领域的著名国际期刊和会议发表相关论文100余篇,Google Scholar统计引用超过20,000次。曾获教育部自然科学一等奖(第2完成人)、中国中文信息学会钱伟长中文信息处理科学技术奖一等奖(第2完成人),入选中国科协青年人才托举工程。担任中文信息学会青年工作委员会主任,中文信息学会社会媒体处理专委会秘书长,期刊AI Open副主编,ACL、EMNLP、WWW、CIKM、COLING领域主席。

论坛讲者

刘知远

清华大学计算机系副教授/博导

大模型「十问」,寻找新范式下的研究方向

2018年以来预训练语言模型技术将深度学习成功用于大规模无标注数据的自监督学习,显著提升了自然语言处理等任务的性能,人工智能进入大模型时代。大模型需要高效并行计算的支持,为机器学习带来全新的范式,更为NLP等场景应用开辟广泛的探索空间。本报告将介绍大模型技术的前沿动态,并总结大模型面临的十个重要问题,希望与广大同行共同探索大模型前沿问题,推动大模型技术的研究与应用。

王士进

科大讯飞副总裁、AI研究院执行院长、认知智能全国重点实验室副主任

正高级工程师,王士进博士在人工智能领域具有丰富的核心技术研究和成果转化工作经验,取得一系列国际领先的研究成果,获得30余项国际比赛冠军,获安徽科技进步一等奖、吴文俊科技进步奖一等奖、中国科协求是杰出青年成果转化奖等奖项称号。2023年5月6号,他带队研发的讯飞星火认知大模型成功发布,获得业内高度评价。

讯飞星火模型最新技术进展及安全实践

近年来,基于大模型的人工智能技术取得了飞速发展,大模型的复杂性、黑盒化、难验证等特性给大模型的安全应用带来了新的挑战。本报告探讨讯飞星火大模型团队在技术研究及安全等方面的最新研究进展,并介绍此领域面临的挑战和未来发展方向。

黄民烈

CCF学术工委秘书长

清华大学长聘教授

博士生导师,国家杰青获得者,计算机系智能技术与系统实验室副主任,清华大学基础模型中心副主任,自然语言生成与智能写作专委会副主任。研究领域为大规模语言模型、对话系统、语言生成,著有《现代自然语言生成》一书。曾获得中国人工智能学会吴文俊人工智能科技进步奖一等奖(第一完成人),中文信息学会汉王青年创新奖,微软合作研究奖等。在国际顶级会议和期刊发表论文150多篇,谷歌学术引用15000多次,h-index 61,入选2022年Elsevier中国高被引学者,连续三年入选AI 2000全球最有影响力AI学者榜单;多次获得国际主流会议的最佳论文或提名(IJCAI、ACL、SIGDIAL等)。研发任务型对话系统平台ConvLab、ConvLab2,世界上最大的中文对话大模型EVA、OPD,智源中文大模型CPM的核心研发成员,是国内大模型研究的主要力量之一,研发AI乌托邦拟人对话交互平台。

大语言模型的安全性研究

随着ChatGPT、GPT-4等大语言模型的智能水平的提升,通用人工智能也越来越接近。但“越智能越危险”,大语言模型的安全性研究变得越来越重要:偏见歧视、隐私、滥用、伦理、价值观等各种安全性问题成为广泛关注的问题,人工智能治理也成为智能社会的亟待规范的课题。讲者将围绕大语言模型尤其是中文大语言模型、对话系统的安全性问题,阐述其在安全类别体系、对抗攻防、隐性毒性内容检测、隐私训练数据抽取、社会伦理道德植入等方面的工作。

薛晖

阿里巴巴集团资深总监,集团安全部算法负责人,人工智能治理实验室主任

他所研发的智能系统支撑了阿里巴巴集团的网络安全、数据安全、内容安全、业务风控等业务;在人工智能与网络安全的顶级会议和期刊上发表论文50余篇,获授权国内国际专利60余项,牵头或参与多项国际国内行业标准的制定,获吴文俊人工智能科学技术奖(第一完成人),著有《算法治理制度之竞争规制》《算法治理制度之算法透明度》等。

大模型时代的算法治理与实践

近期以生成式智能为代表的通用人工智能技术获得了长足的发展,对人类社会各行各业、方方面面都将产生深远的影响。我们应如何看待这种影响和变化,是积极正向还是消极负向,是风险挑战还是新的机遇?结合在阿里巴巴集团风险治理的工作经历,谈谈自己的心得体会。

邱锡鹏

复旦大学计算机学院教授

主要研究方向为自然语言处理基础技术和基础模型,曾获中国科协青年人才托举工程项目、国家优青等项目,获钱伟长中文信息处理科学技术奖一等奖, “爱思唯尔2022中国高被引学者”,主持开发了开源框架FudanNLP和FastNLP,已被国内外数百家单位使用,发布了MOSS、CPT、BART-Chinese等中文预训练模型,在中文模型中下载量排名前列。目前MOSS已经成为国内影响力最大的开源大型语言模型之一。

大型语言模型的科学挑战

自然语言处理领域在近几年取得突破发展,进入到大型语言模型时代。各种自然语言处理任务也逐渐统一到生成式范式,并显示出极强的通用性,极大地推动了自然语言处理任务的性能提升。但是,大型语言模型不仅仅是工程问题,同时也带来了新的科学挑战,包括模型的架构、推理能力来源、幻觉、可解释性等问题。本报告主要介绍大型语言模型的主要科学挑战以及对未来研究的展望。

今年恰逢CNCC创办20周年。二十年来,CNCC已逐渐发展到涵盖数十个方向130场技术论坛,700余位国内外讲者积极参与,超过13000人注册的计算领域年度盛会。二十载不断超越,作为国内计算领域参会人员众多,规模大,水平高的年度盛会,CCF将精心筹划,为参会者带来一场前沿碰撞、展望未来的技术盛宴,让每位参会者都能在CNCC这个超大体量专业平台上提升自身的专业价值,获得前行的动能!等你来,马上行动,欢迎参会报名!

返回首页

返回首页