人工智能是新一轮科技革命和产业变革的核心驱动力量之一。然而,人工智能也将数字世界的安全风险向物理世界跨域蔓延,给国家安全、社会稳定与经济发展带来诸多挑战。提升AI安全性的同时,势必降低其应用过程中的性能表现。

如何有效兼顾上述两方面需求,是性能优先还是安全优先?2021年11月6日,CCF YOCSEF杭州分论坛举办技术论坛“人工智能赋能智慧未来:性能优先vs安全优先”。本次论坛采用“腾讯会议+微信群”的形式,由CCF YOCSEF杭州副主席浙江师范大学彭浩,AC委员浙江大学孙铭阳担任执行主席。

来自学界和业界的重量级嘉宾,包括:贵州大学特聘教授、博士生导师张镇勇,阿里巴巴人工智能治理技术总监李朝,浙江工业大学信息工程学院网络安全研究所所长陈晋音,以及约180名线上参会者就如何构建安全可信且高性能的AI未来展开热烈研讨。

引导发言

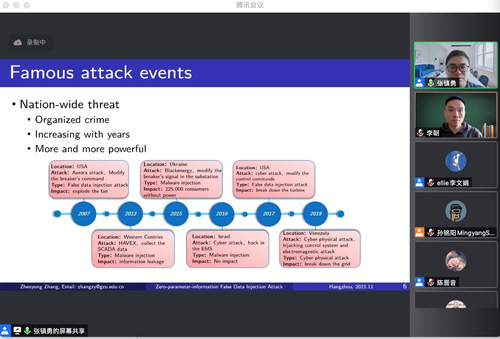

引导发言1——智能电网信息物理安全

张镇勇 贵州大学特聘教授、博士生导师

张镇勇认为智能电网较传统电网而言,具备信息空间和物理空间深度耦合的特性,威胁通过耦合关系进行传递,带来了新的威胁面。比如,委内瑞拉的大停电事件就是信息物理耦合下的一种典型攻击手段,既包含信息侧的入侵,也包括电磁干扰输电线路这种物理侧攻击。此外,电力系统的开放性、复杂性和互操作性等特点,导致电力系统面临着巨大的安全隐患。张镇勇重点介绍了一种虚假数据注入攻击:通过篡改从SCADA采集的运行数据,绕过系统状态估计损害电力系统的可观性,最终影响系统的调度控制决策。

引导发言2——人工智能治理与可持续发展

李朝 阿里巴巴人工智能治理技术总监

李朝指出,阿里巴巴在可持续发展的人工智能模型方面做出了尝试,期望实现可信可靠可用的人工智能技术。其中“可用”指的是:将通用人工智能技术定制化助力生产过程,实现更精细化、低成本的生产过程;“可靠”指的是:开发鲁棒测试平台,整合模型脆弱性的评估指标;“可信”指的是:提高对模型的可解释性研究,同时谨防人工智能模型对特定群体产生的偏见歧视。李朝认为人工智能的可持续发展需要包容协作,为此,阿里巴巴提供了很多公开的数据集,同时积极举办、参加相关的workshop和比赛,希望各个行业领域的科研工作者可以有更多机会进行协作交流,积极探讨对策。

引导发言3——面向人工智能应用的可信安全研究

陈晋音 浙江工业大学信息工程学院网络安全研究所所长

陈晋音指出,目前国际、国家层面纷纷提出了人工智能的发展战略,但人工智能模型仍面临着数据污染,对抗攻击,后门模型,隐私窃取等关键威胁,这些威胁将造成模型性能受损甚至导致用户隐私泄露。陈教授结合团队研究基础,介绍了从图像识别、多智能体到现实信息物理设备等多个领域的攻防安全工作。例如,其团队研发的一种通用对抗样本的防御方法,通过在输入样本上叠加通用扰动,可以使对抗样本的攻击失效,同时维持正常样本的分类结果。

思辨讨论

◆李殊哲

应更关注安全。安全不止是技术问题,也是管理问题,比如各种权限的管理,所以通过管理上的努力,可以兼顾人工智能的性能与安全。

◆曾兰婷

人工智能需要设计一个安全底线,可以通过一些鲁棒方法提升安全底线,进而在保证安全底线的基础上进行性能提升。

◆刘云龙

需要区分场景。通用设施可以提升性能,能源医疗关键基础设施要更注重安全性,强性能弱安全的设备一旦出现问题可能会对社会带来更大的威胁和影响。

◆张镇勇

关键基础设施应当考虑安全优先。

◆李朝

列举了电商领域的案例,在语音交流场景下,人工智能模型与具有抑郁倾向的用户交流时,可能会提出不恰当的建议,这种情况下虽然模型精确地提取了用户的情绪倾向,但可能会对用户带来严重的后果,所以建议增加专家经验作为安全性的功能约束。

◆陈晋音

从公平性角度进行了分析,认为机器很多时候是在自动训练,非人类思维影响的情况下进行预测。应探究在训练过程中算法学到了哪些偏见?以及偏见的产生在模型层面上存在哪些相关性影响?基于这种研究思考,去讨论和评价偏见程度,以及如何进一步从算法层面削弱偏见。

◆王哲

鲁棒性和性能可以分开考虑。应用中可以将鲁棒性作为基准,在基准上提升高效性。在科研中,可以先重点考虑模型的高效性,后续再增加鲁棒性的研究。

◆杜林康

从任务层面上,鲁棒性和高效性的需求并不冲突,目前的问题可能是当前的水印技术存在局限性。

◆张镇勇

产权保护的核心问题是数据或模型隐私。对不同的产权保护方法来说,模型交换过程的水印或权限问题,不会影响模型本身,但是同态加密技术会增大计算量,影响性能。不同防御方法对性能和鲁棒性的影响不同,需根据需求进行权衡。

◆李朝

策略的鲁棒性和模型的高效性可以兼顾。以推荐系统的算法为例,从算法层面增加鲁棒性约束会影响系统性能,但使用双层系统,如线性系统和复杂非线性系统的切换,可以根据场景适应不同需求,使用线性模型提供鲁棒决策,使用复杂系统提供准确推荐,进而兼顾鲁棒性和高效性。

◆陈晋音

策略的鲁棒性和模型的高效性可以兼顾。针对模型或参数的产权保护,目前的研究已经可以兼顾产权保护和性能兼顾。针对模型授权场景的问题,或是涉及密码学的场景,目前的很多加密方法会造成模型性能的损失。

◆苏世帅

当前的技术水平已经满足的很高的功能性,所以今后的研究需要更侧重安全性。

◆严明

功能可靠与模型安全很难兼顾,从数据角度上数据数量越大越有助于性能提升,但是考虑隐私保护的一些技术会对模型训练,应用的实时性具有显著影响,尤其是在工业界秒级的场景。

◆张镇勇

人工智能安全问题有两个层面。系统问题导致的人工智能安全,可通过网络层面解决,而人工智能自身的模型安全问题,可从鲁棒性上进行防御。对于信息物理融合系统而言,不能仅考虑信息层面防御而忽略了物理层,目前许多信息物理协同攻击已涉及到系统控制问题,有必要进行控制层面的综合防御。

◆陈晋音

希望今后的研究能够更多考虑真实物理背景对人工智能系统带来的新威胁。

◆彭浩

人工智能物理信息系统的安全问题极其重要,因为高效的人工智能系统一旦出现漏洞,将具备超乎想象的危害性。

总结与感谢