TF53 预训练时代的大规模知识表示与推理实践会议主席及讲者

会议主席

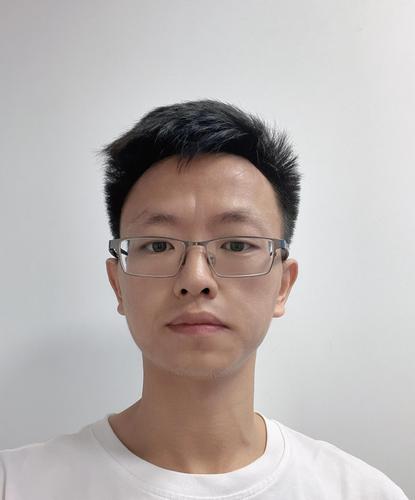

王昊奋

CCF TF知识图谱SIG主席、同济大学特聘研究员

个人简介:同济大学特聘研究员,博士生导师。全球最大的中文开放知识图谱联盟OpenKG发起人之一。负责参与多项国家级AI相关项目,发表100余篇AI领域高水平论文,被引用次数达到2300余次,H-index达到23。他构建了全球首个可交互养成的虚拟偶像—“琥珀·虚颜”;所构建的智能客服机器人已累计服务用户超过10亿人次。目前,他担任中国计算机学会术语工委副主任,SIGKG主席,上海秘书长,中国中文信息学会理事,语言与知识计算专委会副秘书长,上海市计算机学会自然语言处理专委会副主任,上海交通大学AI校友会秘书长等社会职位。

特邀讲者

陈曦

腾讯-PCG-内容平台部 -高级研究员

主题:《Knowledge Enhanced Pretrained Language Models》

《知识增强的预训练语言模型工业界进展与实践》

主题简介:预训练语言模型(Pretrained Language Models)能够通过从大规模无监督数据中学习蕴含在文本中词法、语法、语义等信息,建立了一种新的自然语言处理范式,在各类下游的自然语言任务中取得了最先进性能。然而基于数据驱动的预训练模型更多捕获的还是高频词之间的共现关系,对于一些带有低频长尾、复杂逻辑、常识性知识等特点相关的任务预训练语言模型仍面临不少挑战。为了弥补这个鸿沟,知识图谱和预训练语言模型的结合成为了近几年的研究热点。

本主题重点综述了基于知识增强的预训练语言模型的主流方法,并结合实际业务特点,分析落地过程中的难点和可能的解决方案。

个人简介:博士毕业于浙江大学计算机学院,佐治亚理工学院访问学者,中文信息学会计算与语言专委会委员、医疗健康与生物信息处理专委会委员,先后在阿里巴巴、华为诺亚方舟实验室从事知识图谱和自然语言处理等工作,目前在腾讯内容平台部负责知识图谱、内容审核等相关算法研究工作。在ACL、EMNLP、NIPS、ICLR、WWW、IJCAI等发表多篇论文,曾获PAKDD最佳论文奖,先后获得SuperGLUE全球第二名、CCKS和CHIP实体识别和关系抽取等多个竞赛冠军。

韩先培

中科院软件所研究员

主题:《 Knowledge Probing in Large-scale Pre-trained Language Models》

主题简介:大规模预训练语言模型中包含了海量知识,与传统基于符号的大规模知识图谱可以高效互补。知识探测(Knowledge Probing)的目标是高效准确的探测和利用预训练大模型海量参数中包含的丰富知识。本报告拟介绍PLMs中知识探测的三种代表性范式,包括Prompt-based Retrieval、 Case-based Analogy、和 Context-based Inference,并分析了这三种代表性范式背后的潜在预测机制。同时,针对PLMs中知识探测可能存在的不准确、不一致和不可靠问题,本报告从因果分析的角度出发,总结了知识探测过程中可能存在的Prompt Preference Bias、Instance Verbalization Bias和Sample Disparity Bias及其背后原因,为设计更好的知识探测手段、准确评估大规模预训练语言模型的知识内容提供参考。

个人简介:中科院软件所研究员,担任中文信息处理实验室副主任,入选国家优青、中国科协青年人才托举计划及北京智源青年科学家。主要研究方向为信息抽取、知识图谱及自然语言理解。承担中科院战略先导、科技创新2030课题、国家重点研发专项等十余项课题。在ACL、SIGIR、IJCAI等重要国际会议发表论文60余篇。担任中国中文信息学会理事及语言与知识计算专业委员会副主任。相关成果获中国中文信息学会汉王青年创新奖一等奖及科学技术奖一等奖。

李鹏

阿里巴巴-阿里云智能-计算平台事业部-机器学习平台PAI-算法工程师

主题:《Effective Large Scale Sparse Expert Models for NLG》

《面向自然语言生成的大模型稀疏训练工业界进展综述》

主题简介:自然语言生成(NLG)模型在对话,阅读理解/问答,摘要/标题生成等NLP应用领域扮演重要的作用。由于其具有广泛的应用价值,因此提高模型的性能一直被学术界和工业界所关注。通过增加模型参数量可以有效提升模型在下游任务上的表现,但随着参数量的不断增加,似乎触碰到了高性能集群的性能天花板。以OpenAI推出的1750亿的GPT-3为例,在1024张A100GPU上预估需要34天,一万亿参数的GPT-3在3072张A100显卡上也至少需要84天;微软/英伟达联合推出的5300亿的NLG模型,在2048张A100显卡上耗时了3个月的训练时间才能达到比较好的收敛效果。因此,能否消耗更少的计算资源达到同样的收敛效果是亟待解决的难题。

Mixture of Experts (MoE) 模型结构的出现让人们意识到保持相对稳定的计算量的情况下,可以通过增加模型参数量级来提升模型在下游任务上的性能。本主题对当前主流的MoE算法进行综述,对大模型稀疏化训练进行展望。

个人简介:2013年博士毕业于上海交通大学计算机系,随后在美国得克萨斯大学做博士后,研究方向是深度学习在自然语言处理中的应用。2016年归国后加入腾讯上海优图实验室从事深度学习在NLP和CV中的应用。2019年加入阿里巴巴(阿里云计算平台PAI)进行自然语言处理算法&平台的研发工作。发表ACL & EMNLP等多篇学术论文,并在一些刷榜比赛中取得不错的成绩:CLUE全国第一名,SuperGLUE全球第二名,FewClue全国第一名,CCIR预训练知识度量全国第一名。目前研究方向是大模型预训练基础算法&工程。代表作品:阿里云解决方案: Transformer训练加速框架(Rapidformer), 智能客服对话系统解决方案,自然语言处理算法平台(EasyNLP/EasyTransfer)。

所有评论仅代表网友意见