ADL107《自然语言计算理论与应用》报名通知

CCF学科前沿讲习班

The CCF Advanced Disciplines Lectures

CCFADL第107期

主题 自然语言计算理论与应用

2019年10月9-11日

甘肃 敦煌

学术主任:吴华/Hua Wu 百度首席科学家/Chief Scientist @ Baidu

张奇/Qi Zhang 复旦大学教授/Professor @ Fudan University

万小军/Xiaojun Wan 北京大学研究员/Professor @ Peking University

主办:中国计算机学会

承办:CCF中文信息技术专委

活动日程:

学术专题讲座详细信息

学术专题讲座1

讲者/Speaker:

李磊 字节跳动人工智能实验室总监 / Lei Li, ByteDance AI Lab

周浩 字节跳动人工智能实验室研究员 / Hao Zhou, ByteDance AI Lab

标题:深度文本生成模型

Title: Deep Generative Models for Text Generation

摘要:文本生成技术是自然语言处理中的一项基础技术,在机器写稿、机器翻译、对话、搜索、在线广告等产品上有很多应用。本次讲座将围绕三个方面介绍文本生成中的深度生成模型。一是序列到序列的生成,包括最新的Transformer模型以及它在各种文本生成中的改进。二是比序列生成有更多优势的深度模型,包括生成与编码结合的变分自编码模型(VAE)与对抗生成网络(GAN)。VAE要对离散的文本序列学出光滑连续的隐空间,生成时可以从隐空间采样。而GAN可以附加一个与任务有关的判别器,可以生成与最终任务更相关的文本。第三类是可控贝叶斯方法,可以生成更大多样性和可解释性的文本。最后,我们讲介绍实际场景中的一些应用,例如故事生成,数据到文本的生成,问题生成等。

讲者简介:李磊博士,现任字节跳动人工智能实验室总监、资深科学家,原百度美国深度学习实验室少帅科学家。上海交通大学计算机系本科,卡耐基梅隆大学计算机系博士,加州大学伯克利分校博士后研究员。曾获2012年美国计算机学会SIGKDD最佳博士论文第二名、2017年吴文俊人工智能技术发明二等奖、2017年CCF杰出演讲者。在机器学习、数据挖掘和自然语言理解领域于国际顶级学术会议发表论文40余篇,拥有三项美国技术发明专利。担任CCF中文信息处理专委委员,2017 KDD Cup、2018 KDD Hands-on Tutorial、2019KDD Sponsorship联合主席, IJCAI2017和AAAI 2019资深程序委员、EMNLP2019领域主席和NeurIPS、ICML、KDD、IJCAI、AAAI、NAACL、EMNLP等大会程序委员。

周浩博士,2017年博士毕业于南京大学,现任字节跳动人工智能实验室研究员。他的研究兴趣为机器学习以及机器学习在自然语言理解中的应用,包括句法分析,机器翻译和文本生成等。他曾多次担任ACL, EMNLP, IJCAI, AAAI 和NeurIPS等会议的程序委员会委员,并在相关的顶级会议如NeurIPS、ACL、EMNLP、TACL上发表论文20余篇。目前他的研究工作主要围绕深度生成模型在自然语言处理中的应用展开。

学术专题讲座2

讲者/Speaker:

何晓东 京东人工智能研究院常务副院长、IEEE Fellow / Xiaodong He, JD AI Research

标题:自然语言及多模态智能技术进展及产业应用

Title: Natural Language and Multimodal Intelligence, and their Industrial Applications

摘要:我将首先简略回顾深度学习技术对语音,语言,视觉等方面的驱动,然后着重从两个方面探讨了其在自然语言处理(NLP)方面的前沿研究。语言智能是人类特有的高级智能。NLP技术可大致分成两个方面:一是如何让AI理解人类,如理解意图,解析语义,识别情绪,搜索推荐;二是如何让AI能被人类理解,如文本摘要,内容生成,话题展开,情感对话等,另一方面,基于这些基础AI技术,人机对话与交互系统的研究也取得了突破。对话系统往往涉及到NLP的各个核心问题,除了意图理解、状态跟踪、对话管理、回复生成等基础模块之外,我也会探讨在语义解析,知识图谱,机器阅读,情感和风格表达等前沿方向上的最新研究进展。我还将介绍在自然语言理解和计算机视觉的交叉学科,多模态智能技术领域的一些最新进展,包括语言与图像的理解、推理和生成。具体而言,我将介绍跨语言和视觉的语义表示建模,然后将介绍在图像描述,即理解视觉内容和生成自然语言描述;视觉问答,即跨自然语言和视觉执行推理以推断答案;以及文字到图像合成,即按照自然语言描述生成图像等方面的进展。这些工作也展示了AI拥有一定的“想象力”(比如不但能根据文字描述去画图,还可以在图片中填充一些文字没有描述的细节)。另一方面,人工智能技术的发展也将颠覆许多领域的格局,比如让内容创作平民化。我将回顾几个最近在艺术创造领域使用AI技术的例子,并探讨人工智能会不会融入人类的艺术世界? 同时,我们也比以往更关心这些技术的进步将会如何改变我们的生活。以零售产业为例,我将介绍在京东我们如何应用人工智能技术驱动零售从简单的交易转变成更富有体验感的对话式服务。零售的全过程往往包含多个与顾客交互的环节,比如售前导购和售后服务等。在这些有重要价值的任务中,应用先进的对话式人工智能技术,我们将能够打造可胜任大规模复杂场景的智能交互对话系统,不仅能迅速解答顾客的问题,还能对情感化的诉求提供共情的安抚与引导,从而为顾客提供及时周到的服务。另一方面,智能对话服务技术带来的成本下降和效率提升还将解锁更多之前人力成本无法负担的服务机会,进一步让产业升级。最后,与同学们做一场关于人工智能技术进展与产业影响的开放式对话。

讲者简介:何晓冬博士是京东人工智能研究院常务副院长,深度学习及语音和语言实验室的负责人。他还在华盛顿大学(西雅图)、香港中文大学(深圳)、同济大学、及中央美术学院任兼职教授和荣誉教授。在加入京东集团之前,他曾担任微软雷德蒙德研究院深度学习技术中心的主任研究员和负责人。他的研究主要集中在人工智能领域,包括深度学习,自然语言处理,语音识别,计算机视觉,信息检索和多模态智能。他与合作者在这些领域发表了100多篇论文,谷歌学术统计引用数过万次,并多次获得优秀论文奖及赢得重要的人工智能方面大赛。他与合作者提出的深层结构化语义模型(DSSM/C-DSSM),分层注意力网络(HAN),Image CaptionBot,Bottom-Up Attention等算法广泛应用于语言,视觉,搜索和人机对话等任务。他拥有清华大学和美国密苏里大学的学士和博士学位,并在多个IEEE及ACL的期刊和学术会议担任编委、组委或领域主席。基于其在自然语言和视觉技术及多模态信息处理方面的贡献,他于2018年底入选IEEE Fellow。

学术专题讲座3

讲者/Speaker:

刘兵, 伊利诺伊大学芝加哥分校/北京大学教授,ACM、IEEE、AAAI Fellow / Bing Liu, University of Illinois at Chicago (UIC)/Peking University

标题:终身及持续学习

Title: Lifelong and Continual Learning

摘要:传统的机器学习方法是在封闭的环境中进行单一的隔离任务的学习。它通常需要大量的标注好的训练数据才能进行有效的学习。这种学习方法只适合有限的,有完整定义的任务。在大量的实际场景中,这种隔离的学习范式不是那么的有效。比如我们不可能预训练聊天机器人,自动驾驶汽车或者其它任何人工智能体,使得它们能无缝的工作在真实世界的开放环境中。这是因为我们很难或者不可能永远让人类提供那些包含所有智能体能遇到的场景的知识或者标注数据。智能体因此必须在与环境的持续互动中能做到保留学会的知识,并且使用这些知识使得将来的学习变得更好。当遇到陌生的环境,智能体必须能够利用已有的知识来处理陌生环境并进一步学习。这种泛化的学习能力是人类智能特有的。没有这种能力,一个智能体恐怕很难称的上真正的智能。近些年,我们看到一些新兴的以终身学习,连续学习,开放式学习或者永无止境学习命名的研究趋势。它们试图给予智能体这种能力。在本课程中,我会介绍这些话题和一些近期的进展。

讲者简介:刘兵是伊利诺伊大学芝加哥分校的杰出教授。他在爱丁堡大学获得了博士学位。他的研究兴趣包括情感分析,终身学习,数据挖掘,机器学习和自然语言处理。他在顶级会议和期刊发表了大量的论文。其中2篇论文获得了KDD 10年Test-of-Time奖和1篇论文获得WSDM 10 年Test-of-Time奖。他也是4本书的作者,其中2本关于情感分析,1本关于终身学习,1本关于数据挖掘。他的一些工作被媒体广泛报道,包括纽约时报的首页文章。他是2018 ACM SIGKDD创新奖的获得者。他也是很多顶级数据挖掘会议的程序主席,包括KDD,ICDM,CIKM,WSDM,SDM和PAKDD。他同时也是顶级期刊的副编辑,包括TKDE, TWEB, DMKD和TKDD。他还是很多自然语言处理,人工智能,网络和数据挖掘会议的领域主席或者高级程序委员会成员。他曾经是2013-2017年ACM SIGKDD的主席。他是ACM,AAAI和IEEE会士。

学术专题讲座4

讲者/Speaker:

刘树杰,微软亚洲研究院主管研究员 / Shujie Liu, Microsoft Research Asia

标题:低资源神经机器翻译

Title: Low Resource Neural Machine Translation

摘要: 随着深度学习研究的深入,神经机器翻译在这几年取得了飞速的发展。对于一些资源丰富的语言和特定的领域,比如新闻,大规模训练数据相对容易获得,基于其上训练得到的神经机器翻译甚至能够达到与人工翻译相媲美的水平。然而对于小语种或者一些特殊的领域,大量的双语数据并不是那么容易获得,导致神经机器翻译的质量大幅下降。如何提高神经机器翻译在低资源翻译任务上的性能成为近几年的热门研究方向。在本讲座中,我将介绍几种有效的训练低资源神经机器翻译的方法。具体的,我将介绍两种半监督训练的方法:其一是基于双向翻译一致性的原则联合训练从左到右和从右到左的两个翻译模型;其二是基于大规模的单语数据联合训练源语言到目标语言和目标语言到源语言的翻译模型。另外,如何利用已有的其它语言的大规模双语数据来提高小语种的翻译质量也是一个非常有意义的研究课题,对此,我将介绍一种基于期望最大化的训练方法来将小语种作为两个主流语言之间的隐含状态,并迭代更新主流语言和小语种之间的四个翻译模型。最后,我将介绍如何在不使用任何双语数据的情况下,利用无监督机器翻译的技术来提高神经机器翻译的质量。

讲者简介:刘树杰,微软亚洲研究院主管研究员。刘树杰分别于2007年和2012年从哈尔滨工业大学获得硕士和博士学位。他的研究方向包括自然语言处理、语音处理和深度学习。目前从事基础性的自然语言语音处理的建模、算法,以及创新性的研究工作。他的研究成果被广泛应用于微软产品中,包括Microsoft Translator、 Skype Translator、微软输入法、微软小冰、微软语音服务等。他在国际顶级期刊和会议上发表了超过40篇论文,其中包括11篇ACL,6篇AAAI和5篇EMNLP,并合写了高教出版社出版的专著《机器翻译》。

学术专题讲座5

讲者/Speaker:

刘知远,清华大学副教授 / Zhiyuan Liu, Tsinghua University

标题:知识指导的自然语言处理

Title: Knowledge-Guided Natural Language Processing

摘要:近年来深度学习技术席卷自然语言处理(NLP)各大领域。作为典型的数据驱动方法,深度学习面临可解释性不强等难题,如何将人类积累的大量语言知识和世界知识引入深度学习模型,是改进NLP深度学习模型性能的重要方向,同时也面临很多挑战。本报告将介绍知识指导的自然语言处理的最新进展与趋势。

讲者简介:刘知远,清华大学计算机系副教授、博士生导师。主要研究方向为表示学习、知识图谱和社会计算。2011年获得清华大学博士学位,已在ACL、IJCAI、AAAI等人工智能领域的著名国际期刊和会议发表相关论文60余篇,Google Scholar统计引用超过4000次。承担多项国家自然科学基金。曾获清华大学优秀博士学位论文、中国人工智能学会优秀博士学位论文、清华大学优秀博士后、中文信息学会青年创新奖,入选中国科学青年人才托举工程、中国计算机学会青年学者提升计划。担任中文信息学会青年工作委员会执委、副主任,中文信息学会社会媒体处理专委会秘书长,ACL、EMNLP、COLING、IJCNLP领域主席。

学术专题讲座6

讲者/Speaker:

张敏,清华大学长聘副教授 / Min Zhang, Tsinghua University

标题:个性化推荐研究基础与发展趋势

Title: Foundations and Trends for Personalized Recommendation

摘要:个性化推荐在当前信息消费社会受到越来越多关注。本讲座将包括两个部分:首先介绍个性化推荐研究的一些基础性问题,包括用户的需求讨论、挑战性问题以及现有的技术体系;讲座的第二部分主要介绍个性化推荐研究中新的研究趋势,包括(但不仅限于)用户满意度与评价、可解释的推荐、基于知识图谱与推理的推荐、跨领域异质推荐、推荐的公平性等,最后与听众一起对未来方向进行探讨。

讲者简介:张敏, 清华大学计算机科学与技术系长聘副教授,博士生导师。主要研究领域为个性化推荐、信息检索、用户建模与分析。现任计算机系智能技术与系统实验室科研副主任、网络与媒体技术教育部-微软重点实验室副主任。在重要的国际期刊和会议上发表多篇学术论文,包括TOIS、JIR、WWW、SIGIR 、IJCAI 、CIKM、WSDM、RecSys等,Google Scholar引用3500余次,H-index引用值32。已授权专利12项。担任重要国际期刊TOIS编委,国际会议WSDM 2017和EVIA2019程序委员会主席, SIGIR18 短文主席,SIGIR2019讲座主席,WSDM2019研讨会主席等。获得2016年北京市科学技术一等奖、2018高校计算机专业优秀教师奖励等。长期与企业界开展多项合作。http://www.thuir.cn/group/~mzhang/

报名须知

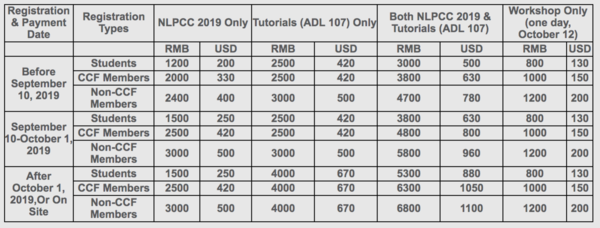

1、参会费用:ADL 107为NLPCC 2019的Tutorials,可以单独报名,也可以和NLPCC 2019主会联合报名,参会费用如下表。

现场报名,需缴纳报名费4000元(仅支持公务卡,银行卡,不收取现金)。本次ADL 107食宿交通自理。根据交费先后顺序,会员优先的原则录取,额满为止。

2、注册报名方式:

(1)扫描如下二维码:

(2)报名链接:http://tcci.ccf.org.cn/nlpcc/2019/index.php

(3)CCF会员报名,请务必在填写在有效期内的CCF会员号,否则按非会员对待。

(4)缴费方式有如下两种:

a. 在报名系统中在线缴费或者通过银行转账

b. 银行转账(支持网银、支付宝):

开户行:北京银行北京大学支行

户名:中国计算机学会

账号:0109 0519 5001 2010 9702 028

请务必注明:姓名+NLPCC2019

报名缴费后,报名系统中显示缴费完成,即为报名成功。

联系

贾爱霞 邮箱:nlpcc@pku.edu.cn,电话:010-82529251

李红梅 邮箱 : adl@ccf.org.cn 电话:010-62562503-18

相关阅读

http://tcci.ccf.org.cn/conference/2019/adlnotice.php

阅读原文

http://tcci.ccf.org.cn/conference/2019/adlnotice.php

返回首页

返回首页